LLM高速化アルゴリズム

LLM高速化アルゴリズム DSD Runtime Log #01

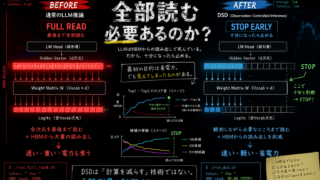

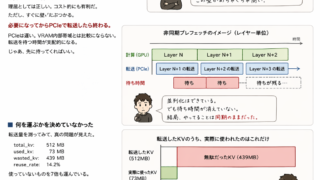

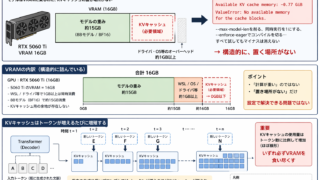

全部読む必要あるのか?全部読む必要あるのか?LLMは計算で遅いわけじゃない。HBMからの読み出しで死んでる。Transformer自体は速い。問題は最後。LM Head。hiddenを全部読んで、全vocabに対して最後まで計算する。しかも...

LLM高速化アルゴリズム

LLM高速化アルゴリズム  LLM高速化アルゴリズム

LLM高速化アルゴリズム  LLM高速化アルゴリズム

LLM高速化アルゴリズム  LLM高速化アルゴリズム

LLM高速化アルゴリズム  LLM高速化アルゴリズム

LLM高速化アルゴリズム